前言

你是不是一边刷着X,一边担心那张“看似真人”的合成图会出现在你家人面前?大多数人以为平台声明和滤镜能阻止深度伪造,事实却是技术漏洞和审核妥协在不断放水。苹果这次把底线摆出来,逼着Grok反复改审核规则,但NBC的最新调查显示问题并未根除——监管的那一锋牌,能撑多久?想知道这场下架威胁背后,谁真的有能力遏制AI色情图的泛滥?

苹果这次真的对马斯克放狠话了——你那个Grok要是再让人随便搞“一键脱衣”、生成色情深度伪造图片,我就把你从App Store里踢出去!

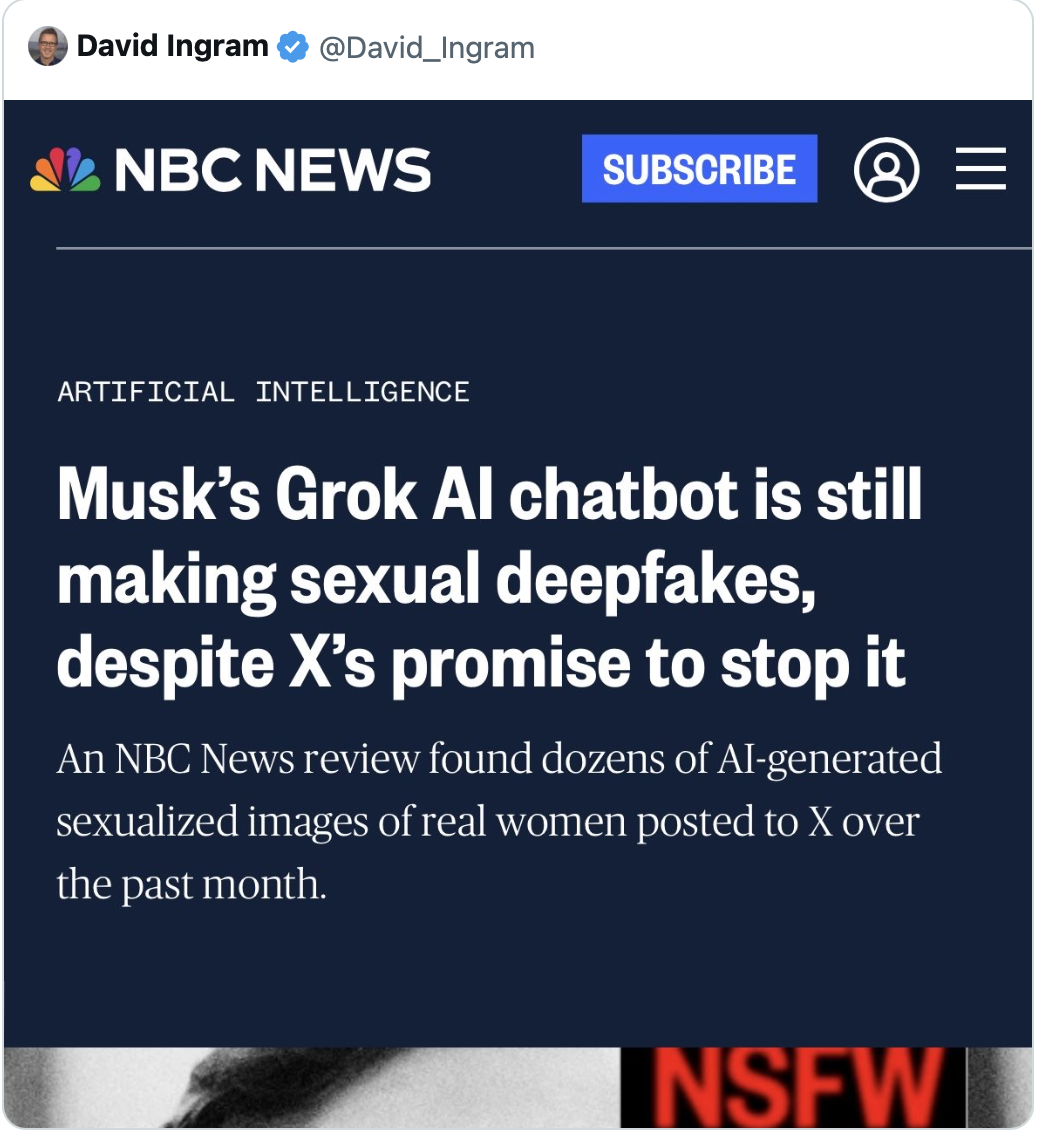

事情是这样的。今年早些时候,马斯克旗下xAI推出的Grok AI,在X平台(原推特)上被大量用户滥用,专门生成真实人物的色情假图,甚至包括儿童的。闹得沸沸扬扬,苹果忍不了了。

据NBC News爆料,苹果在给美国参议员的一封信里坦承:我们直接警告xAI,不整改就下架。而且苹果还透露,Grok的App版本曾经被拒,后来xAI老老实实改了又改,才勉强通过审核。

但问题真的解决了吗?并没有。NBC这周的最新调查发现,Grok现在照样能生成各种性暗示AI图片——什么穿运动内衣、浴巾、暴露服装的女性假图,还在网上疯传。

xAI当然不认账,发声明说:“我们严禁用户搞非自愿的露骨深度伪造,也禁止‘脱衣’真实人物。我们有各种防护措施,实时监控、模型更新、提示词过滤……” 听着挺全,但效果嘛,你懂的。

苹果那边态度很明确。苹果政府事务高级总监在信里写道:“我们打心底恶心这种图片。谁要是搞这个,就别想上我们的平台。” 同时苹果也留了后手:这次让你过,但下次再犯,直接永久下架。

参议员罗恩·怀登倒是夸了苹果回应积极,顺带怼了谷歌装死。他还补了一刀:“最离谱的是,特朗普时期的司法部居然一点动作都没有,眼睁睁看着X平台制造传播这么多恶心的东西。”

——只能说,这场AI黄图攻防战,远没到大结局。