OpenAI 最近一口气推出了三款即时语音模型——GPT-Realtime-2、GPT-Realtime-Translate 和 GPT-Realtime-Whisper。目标是让语音助手的反应更快、更聪明,同时具备边听边翻译、边录边转录的能力。

你可能已经用过 ChatGPT 或 Google Gemini 的语音模式,但之前的语音 AI 在推理能力上一直比不上纯文本模型。原因在于,真正的语音助手不仅要“听懂字”,还得能实时理解意图、记住上下文、灵活应对打断,并给出恰当的回应。OpenAI 表示,新模型正是为了解决这些痛点而设计。

三大创新语音模式

OpenAI 设计了三种可以组合使用的互动方式:

-

语音转行动(Voice-to-Action):用户口述需求,系统自主推理并调用工具完成任务,比如订票、查天气。

-

系统转语音(Systems-to-Voice):软件将数据转换成语音提示。例如旅游 App 主动告知用户“您的登机口已变更”。

-

语音转语音(Voice-to-Voice):实时跨语言对话。德国电信已在客服场景中测试该功能。

官方表示,这些能力将很快整合进 ChatGPT 的语音模式,语音将真正成为主要交互界面。

GPT-Realtime-2:语音界的 GPT-5 级推理能力

本次发布的核心是 GPT-Realtime-2。OpenAI 称其推理能力已达到可媲美 GPT-5 的水平。该模型专为即时语音互动设计,能够一边对话一边思考、调用工具,并处理对话中断的情况。

技术亮点包括:

-

上下文窗口从 32,000 扩展到 128,000 token,能承载更长的复杂对话。

-

支持并行调用多个工具,并用“让我查一下”等短句告知用户正在处理中。

-

即便遇到问题也不会沉默,会主动说“我现在遇到了一些问题”。

-

对专有名词、人名、医学术语的识别更精准,语气控制更灵活。

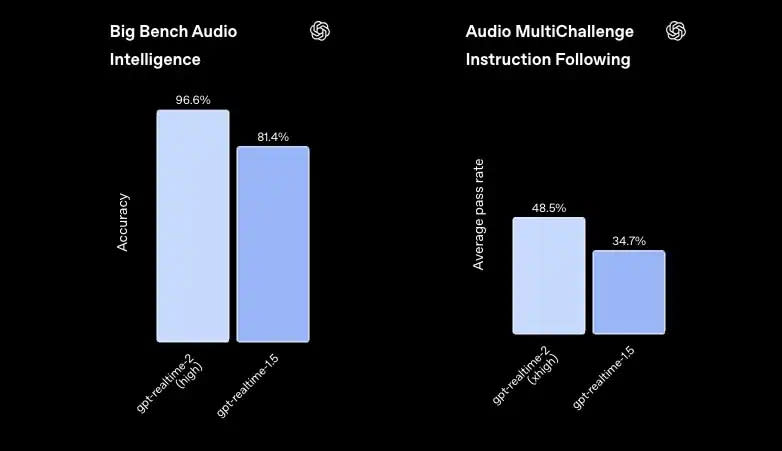

开发者可设置五种推理强度,默认为“低”,以保证简单请求的低延迟;复杂任务则可调用更多计算资源。在基准测试 Big Bench Audio 中,高设定下的准确率从上一代 GPT-Realtime-1.5 的 81.4% 提升至 96.6%,提升显著。

即时翻译与转录模型同步上线

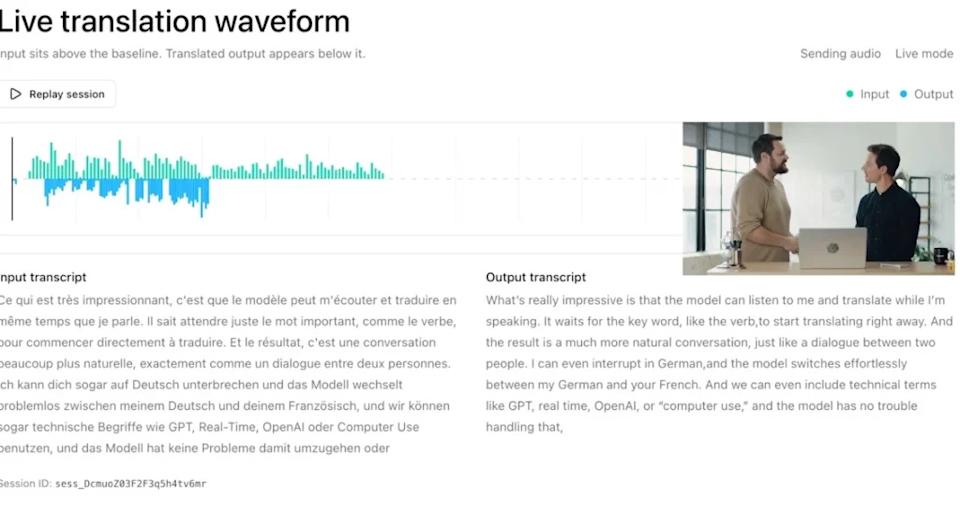

GPT-Realtime-Translate 是一款独立的实时翻译模型,支持超过 70 种输入语言和 13 种输出语言。它能在保持语义完整性的同时,跟随说话者的语速,并应对上下文切换、地域口音和专业术语。适用场景包括客服、跨境销售、教育和媒体等。

GPT-Realtime-Whisper 是一款低延迟的串流转录模型,可实时转录语音内容,适用于会议、课堂和广播的即时字幕。企业可利用它在对话中自动生成笔记与摘要,或构建具备连续语音理解能力的语音助手。

定价与可用性

三款模型已通过 Realtime API 开放,并可在 Playground 中测试。定价如下:

-

GPT-Realtime-2:每百万语音输入 token 32 美元

-

GPT-Realtime-Translate:每分钟 0.034 美元

-

GPT-Realtime-Whisper:每分钟 0.017 美元